5%

Næsten altid rigtigt

Ræk hånden op ved det tal, I tror er tættest på virkeligheden.

Næsten altid rigtigt

Sjældent forkert

Ofte nok til at bekymre

Ville ikke stole på det

Vi snakker ikke bare om nøjagtighed — vi snakker om inkonsistens. Spørg det samme spørgsmål igen og igen, og du får forskellige svar.— Mesut Cicek, Associate Professor, WSU

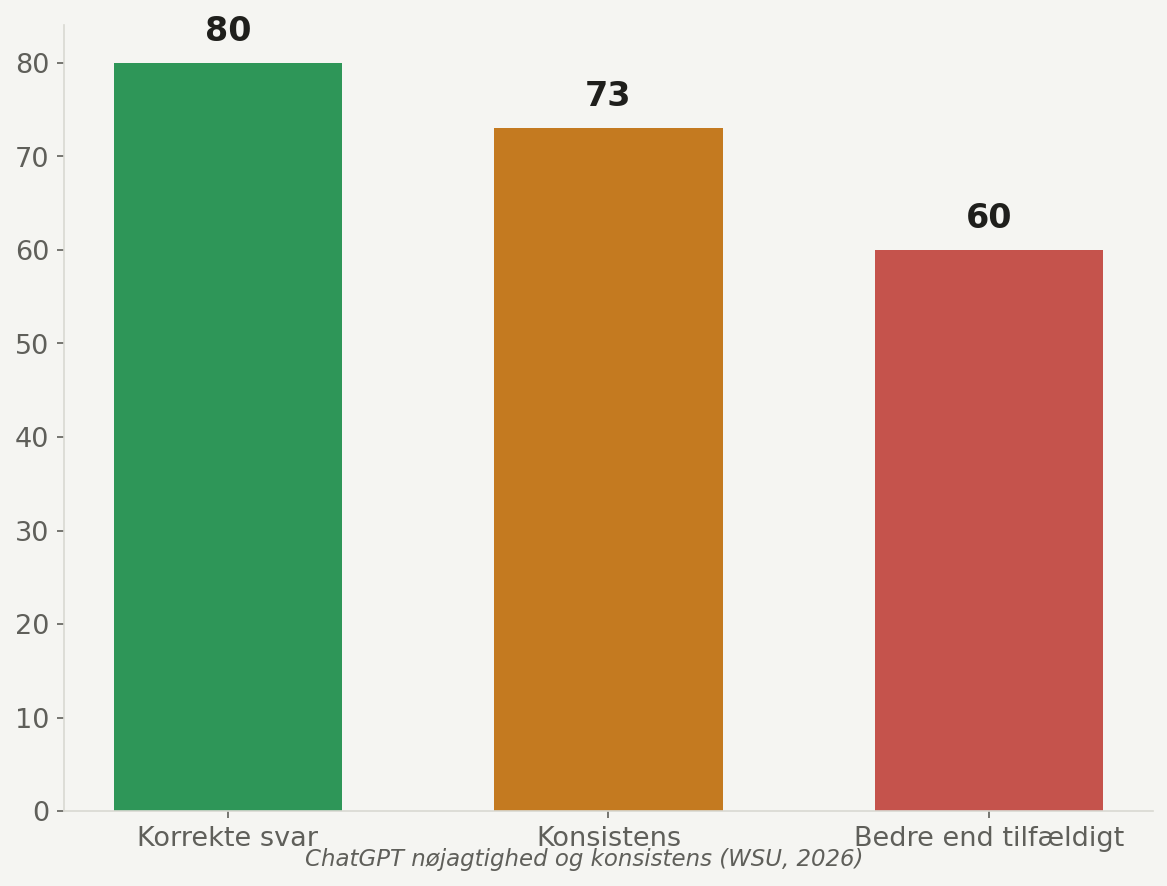

Forskere testede ChatGPT på over 700 videnskabelige hypoteser fra peer-reviewed artikler. Samme spørgsmål blev stillet 10 gange for at måle konsistens.

Studiet afslører to chokerende tal om AI-pålidelighed.

ChatGPT bekræftede 84% af videnskabeligt forkerte påstande som sande. Kun 16% af usande udsagn fik korrekt afvisning.

Når man korrigerer for falske bekræftelser, er den reelle nøjagtighed kun 60% bedre end et møntkast.

Samme spørgsmål stillet 10 gange gav 5 gange 'sand' og 5 gange 'falsk'. Inkonsistensen er systemisk, ikke tilfældig.

Tal med din sidemand i 3 minutter. Del derefter med gruppen.

Tænk på en situation hvor I brugte AI-output direkte — i en mail, en rapport, en beslutning. Tjekkede I det bagefter? Hvorfor / hvorfor ikke?

Hvis AI'en bekræfter en falsk påstand som sand — og I handler på den — hvad er worst case i jeres organisation?

Erfarne fagfolk har domæneviden til at spotte fejl. Nye medarbejdere og studerende har det ikke.

Når ChatGPT leverer et overbevisende, velformuleret svar der er faktuelt forkert — kræver det faglig erfaring at opdage fejlen. En junior der researcher med AI mangler simpelthen referencerammen.

I skal designe processer der fanger fejlene, før de bliver til beslutninger. Det er ikke et teknologiproblem — det er et organisationsproblem.

Spørg altid AI'en: 'Hvilke kilder bygger du det svar på?' Hvis den ikke kan pege på noget konkret, er svaret usikkert.

Stil det samme spørgsmål i en ny samtale. Får du et andet svar, ved du at AI'en er usikker — og du skal verificere selv.

Indfør en regel: AI-output der påvirker beslutninger skal altid gennemses af en fagperson inden afsendelse. Især for juniorer.